Google Website indexieren: Der strategische Guide für maximale Sichtbarkeit

Du hast Stunden in hochwertigen Content investiert, das Design optimiert und die Technik glattgezogen, doch in den Suchergebnissen taucht deine Seite einfach nicht auf? Das Problem ist oft nicht die Qualität deiner Inhalte, sondern ein Stocken im Prozess der Indexierung.

Um im digitalen Wettbewerb zu bestehen, reicht es nicht mehr aus, darauf zu warten, dass der Googlebot zufällig vorbeischaut. Du musst den Prozess aktiv steuern. Als deutschlandweit aktive SEO Agentur Stuttgart unterstützen wir dich dabei, genau diese Prozesse zu optimieren. In diesem Guide erfährst du, wie du deine Google Website indexieren lässt, Fehler behebst und selbst bei großen Enterprise-Projekten für eine blitzschnelle Aufnahme in den Suchindex sorgst.

Crawling vs. Indexierung: Den Prozess verstehen

Bevor wir in die technischen Details gehen, müssen wir zwei Begriffe klären, die oft verwechselt werden: Crawling und Indexierung.

- Crawling: Der Googlebot entdeckt deine URLs, indem er Links folgt oder Sitemaps liest.

- Indexierung: Google analysiert den Inhalt der gecrawlten Seite und entscheidet, ob diese in den Index aufgenommen wird.

Nur was im Index ist, kann auch ranken. Dabei spielen technische Signale eine ebenso große Rolle wie die inhaltliche Relevanz. Ein tieferes Verständnis für SEO Meta Tags hilft dir dabei, dem Bot bereits beim ersten Besuch die richtigen Anweisungen zu geben.

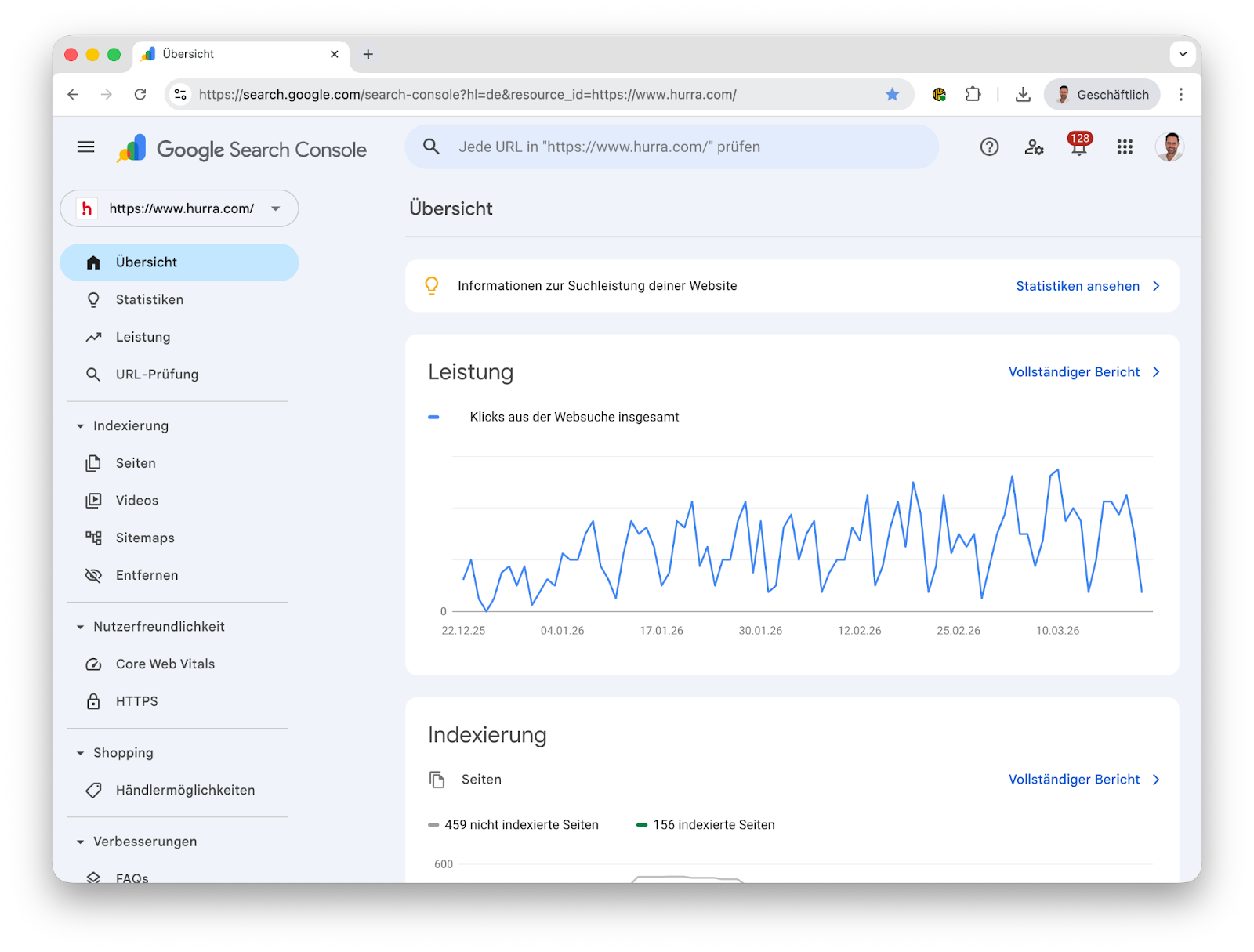

Die Basis: Website bei Google anmelden via Search Console

Der direkteste Weg führt über die Google Search Console (GSC). Sie ist das Cockpit für jeden Webmaster. Ohne eine verifizierte Property hast du kaum Kontrolle darüber, wie Google deine Domain wahrnimmt.

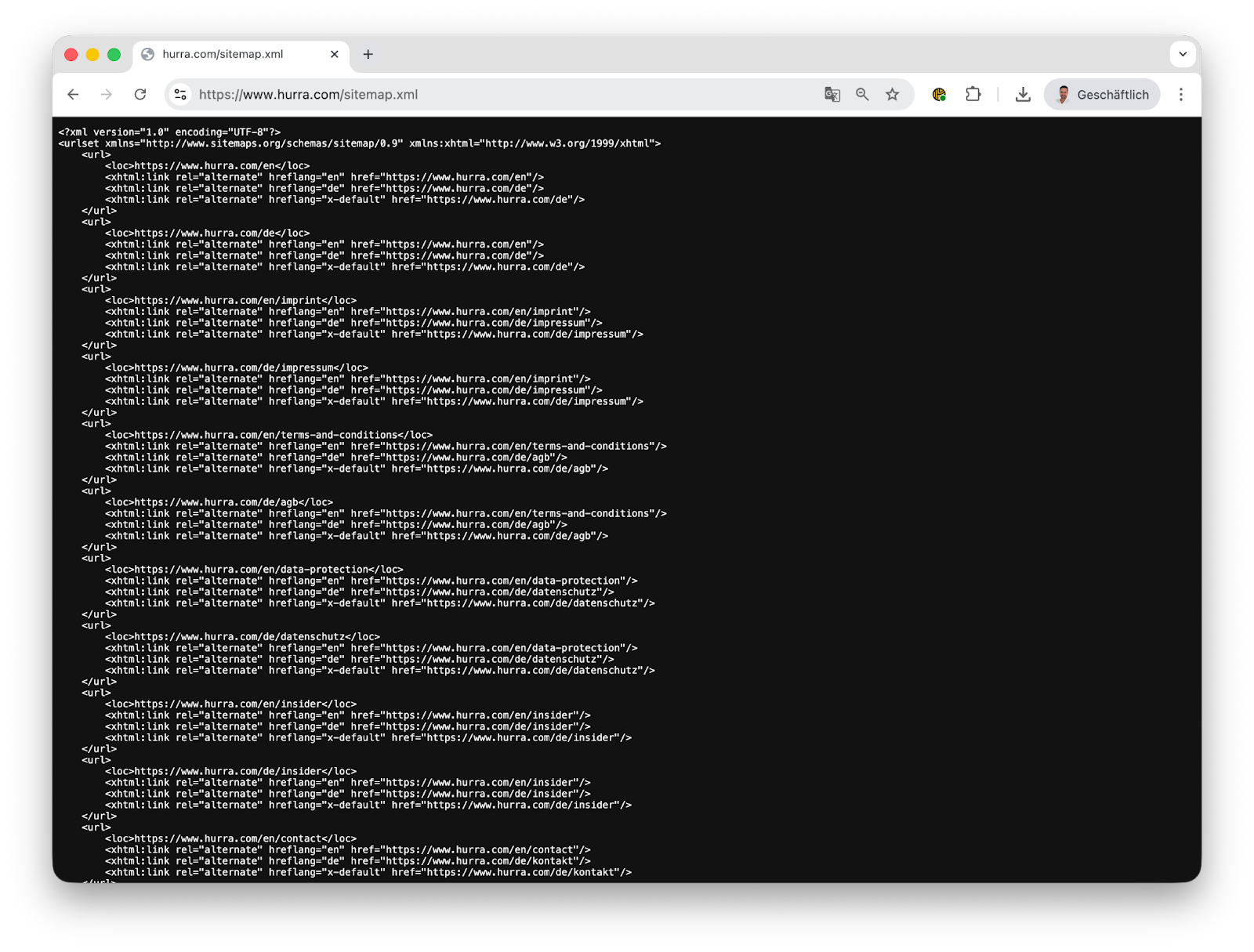

Sitemap.xml: Das Inhaltsverzeichnis für den Googlebot

Eine XML-Sitemap ist eine Liste aller URLs, die Google indexieren soll. Anstatt darauf zu hoffen, dass der Bot alle internen Verknüpfungen findet, reichst du ihm die Struktur proaktiv ein. Besonders bei neuen Projekten oder umfangreichen Relaunches ist dies der erste Schritt zur Sichtbarkeit.

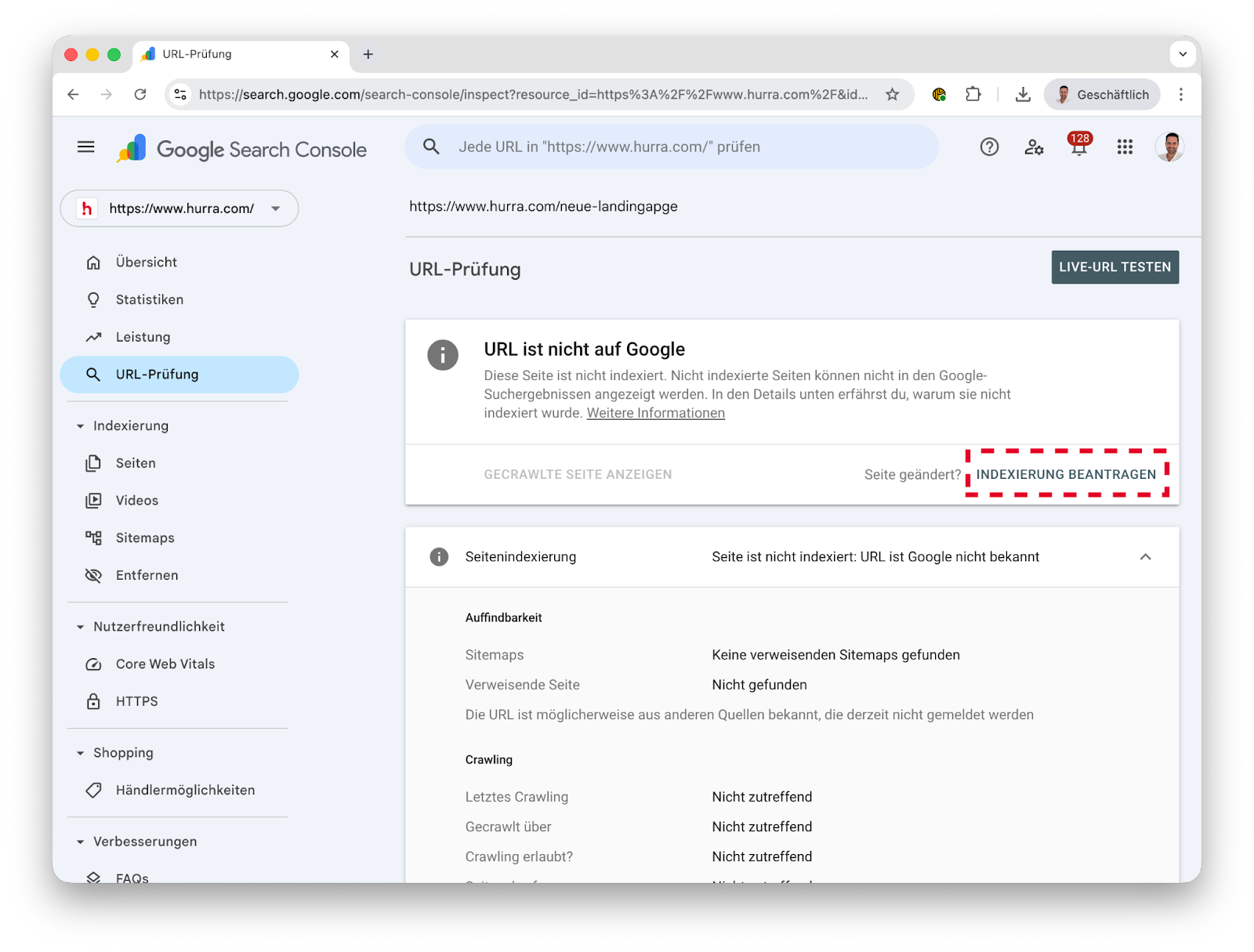

Das URL-Prüftool: Indexierung manuell anstoßen

Hast du eine neue, extrem wichtige Seite veröffentlicht? Mit dem URL-Prüftool in der GSC kannst du die „Indexierung beantragen“. Dies stellt die URL in eine Warteschlange. Aber Vorsicht: Bei tausenden URLs ist dieser manuelle Weg nicht skalierbar. Hier kommen automatisierte Lösungen ins Spiel.

Indexierung beschleunigen: Profi-Strategien für Enterprise-Projekte

Für große E-Commerce-Plattformen oder News-Portale ist das Standard-Vorgehen oft zu langsam. Wenn du Millionen von URLs verwaltest, wird das Crawl-Budget zum limitierenden Faktor.

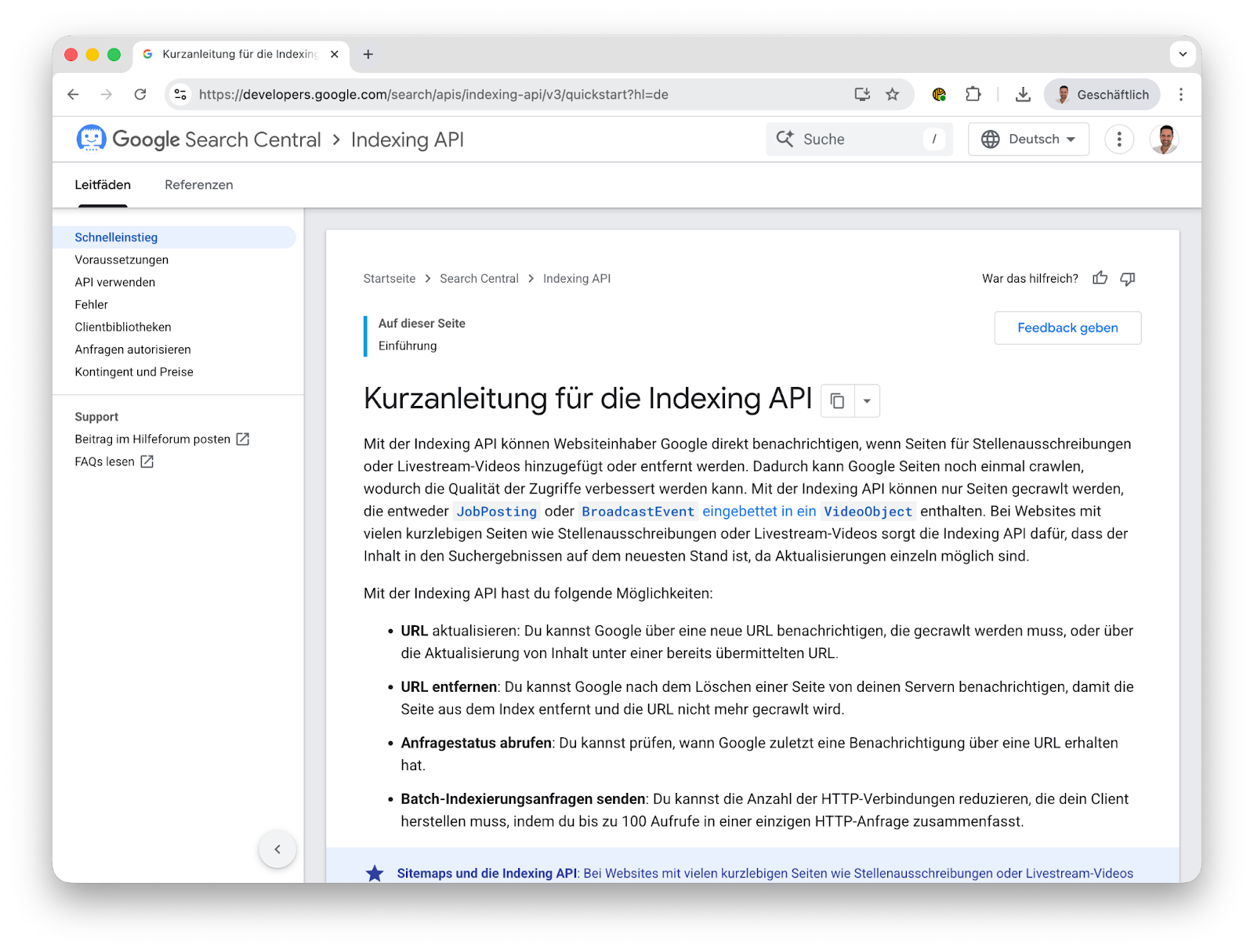

Google Indexing API: Schnelle Crawling-Signale nutzen

Die Google Indexing API wurde ursprünglich für Stellenanzeigen und Livestreams entwickelt und wird offiziell nur für diese Inhalte unterstützt.

In der Vergangenheit wurde sie von SEO-Experten auch für andere URLs genutzt, um Google schneller auf neue oder aktualisierte Inhalte aufmerksam zu machen. Google stellt jedoch klar, dass diese Nutzung nicht vorgesehen ist und keinen garantierten Effekt hat.

Die API sendet lediglich ein Crawling-Signal, eine Indexierung wird nicht erzwungen. Die Implementierung erfolgt technisch über Service Accounts, meist via Python oder Node.js, und kann den Prozess im Vergleich zum klassischen Crawling beschleunigen, sofern Google das Signal berücksichtigt.

Interne Verlinkung und Crawl-Budget-Optimierung

Der Googlebot priorisiert Seiten, die gut vernetzt sind. Eine flache Hierarchie sorgt dafür, dass wichtige Inhalte nur wenige Klicks von der Startseite entfernt sind. Ein effizientes Crawl-Budget-Management stellt sicher, dass Google seine Ressourcen nicht auf unwichtigen Parameter-URLs verschwendet, sondern dort investiert, wo dein Umsatz generiert wird.

Fehlerdiagnose: Warum Google deine Website nicht indexiert

Manchmal verweigert Google die Aufnahme trotz korrekter Anmeldung. Die GSC liefert hier oft kryptische Meldungen.

Das „Quality Gate“: Gecrawlt – zurzeit nicht indexiert

Diese Meldung ist oft ein versteckter Hinweis auf mangelnde Qualität oder Duplicate Content. Google hat die Seite gesehen, hält sie aber (noch) nicht für wertvoll genug für den Index. Hier hilft nur eine radikale Content-Optimierung oder die Stärkung der E-E-A-T Signale (Expertise, Erfahrung, Autorität, Vertrauen).

Technische Stopper: Robots.txt und Noindex-Tags

Ein klassischer Fehler: In der robots.txt wurde versehentlich das Verzeichnis gesperrt, oder ein vergessenes noindex-Tag aus der Development-Phase verhindert die Aufnahme. Prüfe regelmäßig deine technischen Header-Antworten.

Fazit: Indexierung als Performance-Hebel

Die Indexierung ist kein „Set-and-forget“-Prozess. Sie ist die technologische Grundvoraussetzung für deinen SEO-Erfolg. Indem du die Google Search Console meisterst, Sitemaps strategisch einsetzt und bei Bedarf auf API-Lösungen setzt, verkürzt du den Weg von der Veröffentlichung bis zum Ranking massiv.

Hast du Fragen zur Skalierung deiner Indexierung oder benötigst du eine individuelle Strategie für ein komplexes Webprojekt? Dann nimm direkt Kontakt zu uns auf. Gemeinsam bringen wir deine Inhalte dorthin, wo sie hingehören.

FAQ: Die 9 wichtigsten Fragen zur Google Indexierung

Wie lange dauert es, bis Google eine Website indexiert?

Das variiert zwischen wenigen Stunden und mehreren Wochen. Mit der Google Search Console und einer Sitemap lässt sich der Prozess beschleunigen.

Ist die Indexierung bei Google kostenlos?

Ja, Google erhebt keine Gebühren für das Crawling und Indexieren von Webseiten.

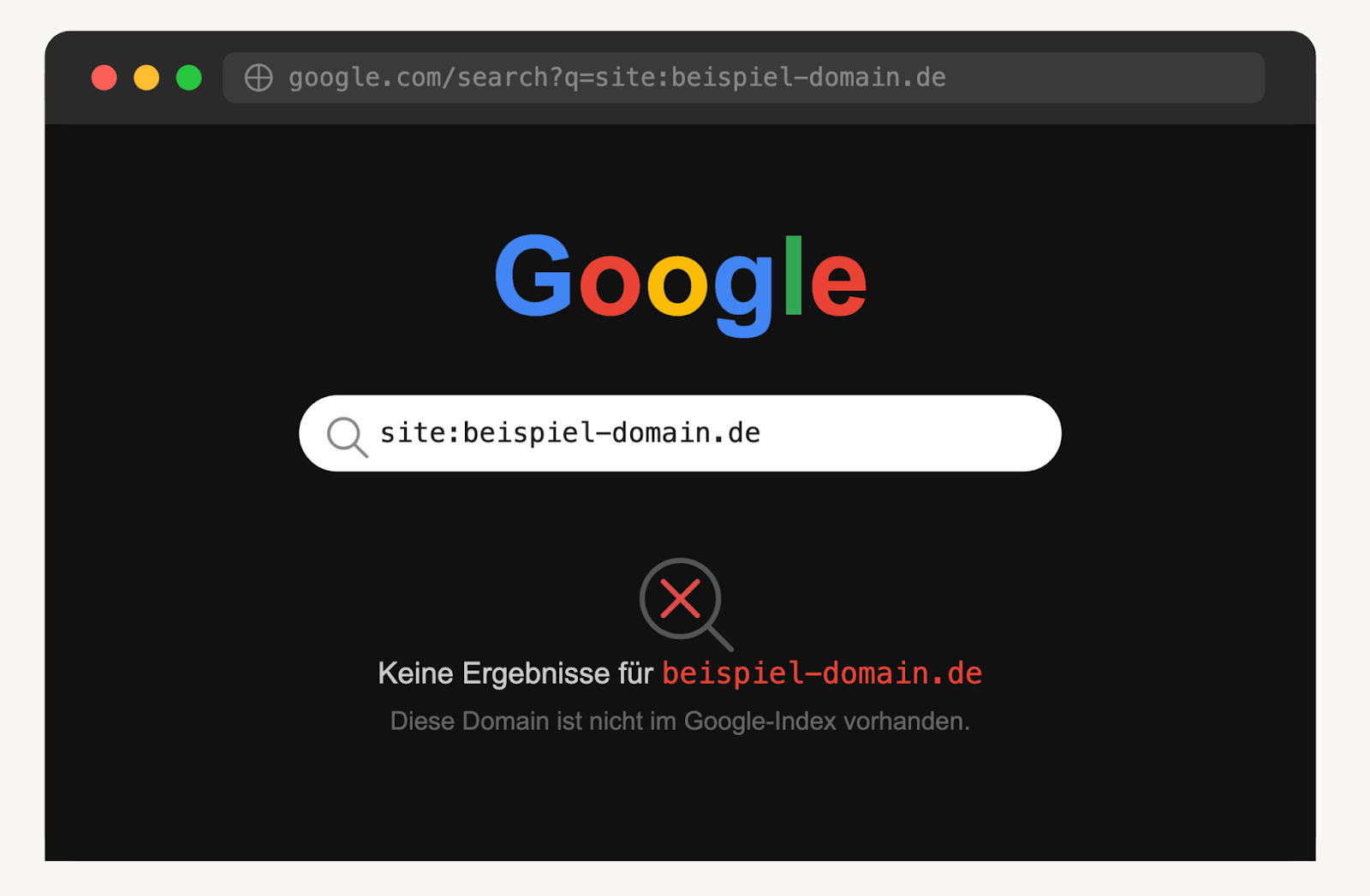

Wie kann ich prüfen, ob meine Seite indexiert ist?

Nutze den Suchbefehl site:deinedomain.de bei Google oder prüfe den Status im URL-Prüftool der Google Search Console.

Warum wird meine Website trotz Anmeldung nicht indexiert?

Häufige Gründe sind technische Sperren (Robots.txt, Noindex), mangelnde Content-Qualität oder fehlende interne Verlinkung.

Was ist der Unterschied zwischen Crawling und Indexierung?

Crawling ist das Entdecken von Seiten durch den Bot; Indexierung ist die Speicherung und Einordnung der Inhalte in der Google-Datenbank.

Was bedeutet „Gecrawlt – zurzeit nicht indexiert“?

Google hat die Seite besucht, sich aber gegen eine Aufnahme entschieden, oft wegen Qualitätsmängeln oder ähnlichen Inhalten auf der Domain.

Kann ich die Indexierung erzwingen?

Ein echtes „Erzwingen“ gibt es nicht, aber das URL-Prüftool und die Indexing API sind die stärksten Signale, um Google zur sofortigen Prüfung zu bewegen.

Wie wichtig ist die Sitemap.xml wirklich?

Sie ist essenziell für die effiziente Steuerung des Bots, besonders bei großen Seiten oder Inhalten, die schwer über interne Links erreichbar sind.

Verhindert Duplicate Content die Indexierung?

Ja, Google versucht den Index sauber zu halten. Identische Inhalte werden oft nicht indexiert oder zugunsten einer kanonischen URL ignoriert.